Mag ik spraaktechnologie en AI zomaar inzetten bij patiënten?

Het gebruik van AI en spraaktechnologie is afhankelijk van wat jouw organisatie toestaat. Daarbij is het van belang dat de AI Act wordt gehandhaafd.

Er is momenteel nog geen strikte handhaving op het gebruik van spraaktechnologie in de zorg, maar dit komt wel in de nabije toekomst. Volgens de AI Act en de FDA, wordt bij AI in de zorg namelijk uitgegaan van de zogenoemde hoog-risico categorie, met daarbij "high-risk = high-penalty".

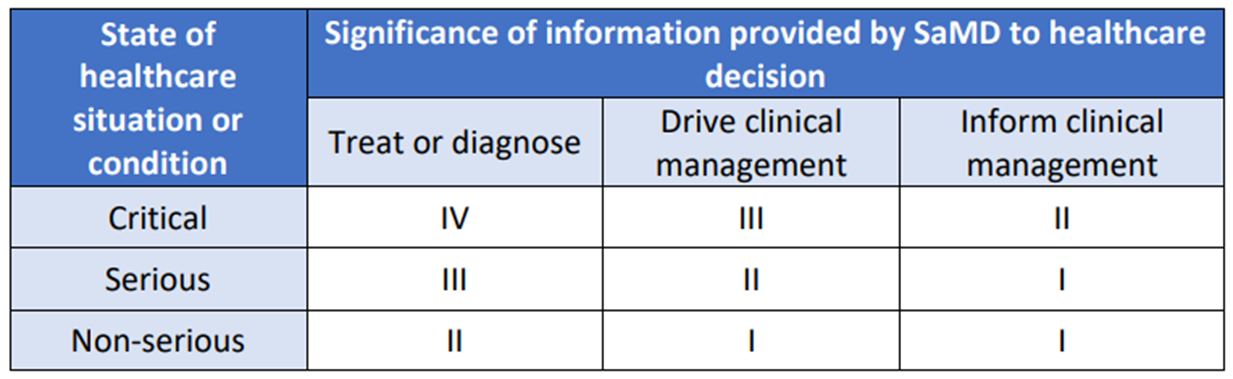

Wij sluiten ons erbij aan dat veiligheid voorop staat. Elke applicatie in de zorg valt in de hoge risico klasse. Als we kijken naar het FDA gebaseerde het MDRF-risicoraamwerk dat identificeert de volgende twee belangrijke factoren die een beschrijving geven van het beoogde gebruik van de Software als Medisch Hulpmiddel (SaMD):

- De significantie van de informatie die door de SaMD wordt verstrekt voor de zorgbeslissing, die het beoogde gebruik van de door de SaMD verstrekte informatie identificeert - d.w.z. om te behandelen of te diagnosticeren; om klinisch management te sturen; of om klinisch management te informeren; en

- De staat van de gezondheidssituatie of -toestand, die de beoogde gebruiker, ziekte of aandoening en de populatie voor de SaMD identificeert - d.w.z. kritieke; ernstige; of niet-ernstige gezondheidssituaties of -toestanden.

Hieruit kunnen we opmaken dat bijvoorbeeld triage systemen onder hoog risico klasse III vallen en hiermee zeker ISO13485 klasse IIB gecertificeerd zullen moeten zijn. Alhoewel dit (voorlopig) nog niet gehandhaafd wordt voor spraak-naar-tekst applicaties, zijn wij wel begonnen met het traject van deze certificering.

Welke verplichtingen heeft ontwikkelaar/leverancier?

Het is voor ons een verplichting om te zorgen voor:

- Technische documentatie, gebruiksinstructies verstrekken, voldoen aan de auteursrechtrichtlijn en een samenvatting publiceren over de inhoud die voor training is gebruikt.

- Modelevaluaties uitvoeren, tegenstrijdige tests doen, ernstige incidenten bijhouden en melden en zorgen voor cybersecuritybescherming.

Om hiervoor zorg te dragen hebben wij een uitgebreide evaluatie module ontwikkeld die de zorgverlener in staat stelt om ieder LLM of template met prompts te kunnen beoordelen.

Hiermee voldoen we aan het onderdeel om constant de modelevaluaties uit te voeren. Met name in de huidige AI-ontwikkelingen waarbij de LLM's ieder kwartaal verdubbelen in kennis en kunde, is dit juist een cruciaal onderdeel.